Human-in-the-Loop가 완성하는 AI 실행, 그리고 통합 인텔리전스 코어

Makebot Insight Team

AI Market Intelligence Unit

기업의 AI 도입은 단순한 자동화를 넘어, 인간과 AI가 어떻게 협업하며 실행할 것인가라는 운영 구조의 문제로 진화하고 있습니다. 많은 조직이 생성형 AI를 도입했지만, 분절된 시스템과 통제되지 않은 자율성으로 인해 오히려 생산성 저하와 신뢰 리스크를 경험하고 있습니다. 본 백서는 이러한 한계의 원인을 기술이 아닌 운영 모델의 부재로 규정하고, 완전 자율이 아닌 Human-in-the-Loop(HITL)를 중심으로 한 관리형 자율성(Managed Autonomy)을 2026년을 위한 현실적 해법으로 제시합니다. AI는 즉각 실행 주체가 아니라 구조화된 제안을 생성하는 역할을 수행하고, 인간은 명확한 통제 지점에서 승인과 판단을 담당합니다. 이를 통해 조직은 환각 리스크를 제거하면서도 실행 속도와 확장성을 동시에 확보할 수 있으며, CX와 EX를 단일한 인텔리전스 흐름으로 연결하는 지속 가능한 에이전틱 협업 모델로 전환할 수 있습니다.

22 Page PDF Report

이 백서를 반드시 읽어야 할 분들

CX·EX 리더: 인간과 AI의 역할 분담이 설계되지 않아, 자동화는 늘었지만 고객·직원 경험의 일관성과 신뢰가 흔들리고 있는 조직의 책임자C-Level 및 임원진: AI를 단기 비용 절감 도구가 아니라, 인간–AI 협업 기반의 장기 경쟁 우위와 운영 역량으로 전환하려는 전략적 의사결정자DT·IT·AI 전략 책임자: 보안·컴플라이언스·감사 가능성을 전제로, LLM과 에이전틱 AI를 실제 운영 환경에 안전하게 확장할 아키텍처를 설계해야 하는 분운영·백오피스·L&D 책임자: 지식은 많지만 실행으로 연결되지 않는 조직 구조에서 벗어나, AI를 디지털 동료로 내재화하려는 실행 중심 리더Key Takeaways

Human–AI 협업은 기술 문제가 아니라 운영 모델의 문제

AI 성과 격차의 원인은 모델 성능이 아니라, 인간과 AI의 역할·책임·통제 구조가 설계되지 않았기 때문입니다.HITL은 예외 대응이 아닌 표준 실행 구조

Human-in-the-Loop는 AI 실패 시 개입하는 안전장치가 아니라, 고부가가치 워크플로 전반에 적용되는 핵심 운영 원칙입니다.제안 기반 실행이 신뢰와 확장성을 동시에 만든다

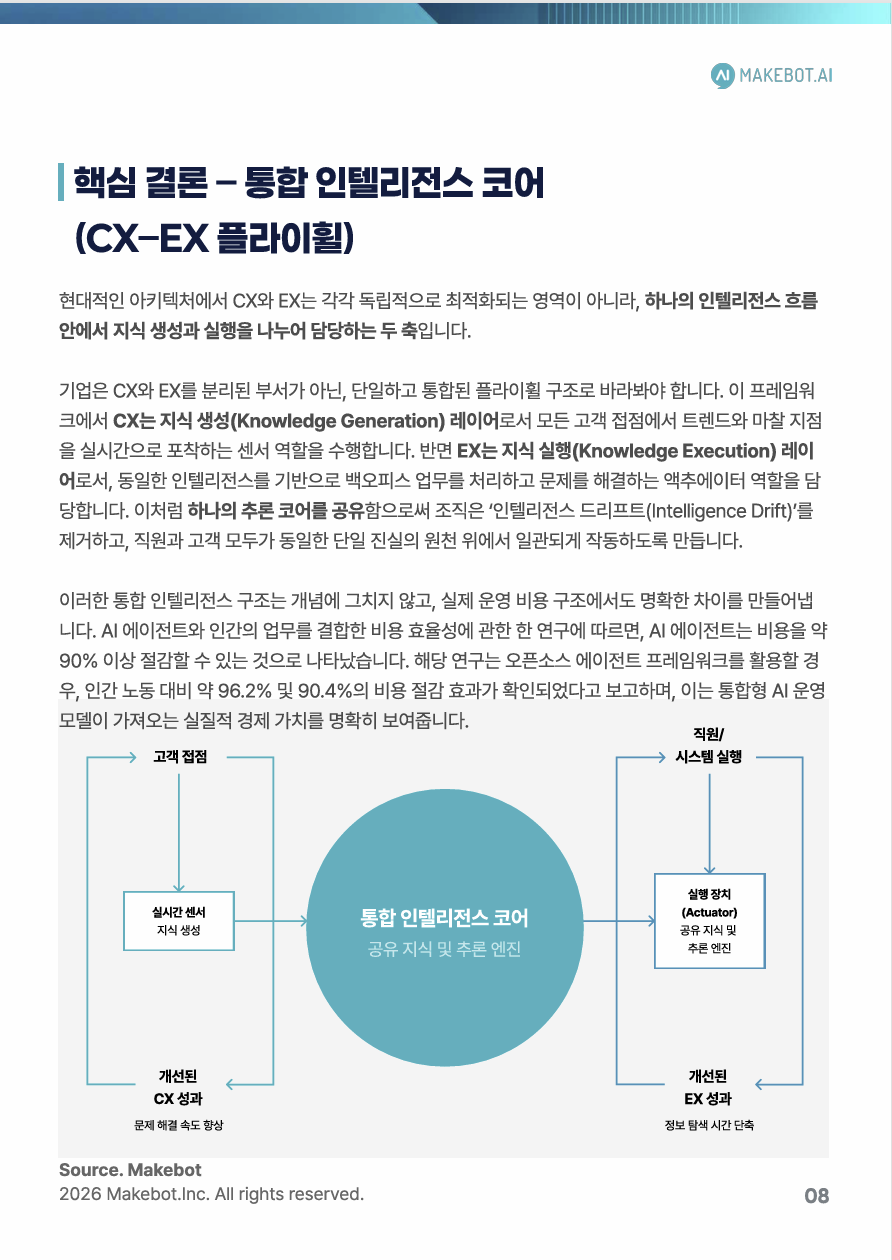

AI는 ‘실행 주체’가 아니라 ‘제안 엔진’으로 작동하며, 모든 실행은 인간 승인과 감사 가능한 기록 하에서 관리됩니다.통합 인텔리전스 코어가 CX–EX 성과를 연결한다

상담·음성·문서·내부 업무를 단일 인텔리전스 코어로 통합할 때, 비용은 줄고 운영 효율과 확장성은 극대화됩니다.Agentic AI의 목표는 자동화가 아니라 지속 가능한 ROI

무제한 자율성보다 신뢰·책임·거버넌스를 우선할 때, AI는 단기 효율이 아닌 장기 경쟁력을 창출합니다.